در چند سال اخیر، هوش مصنوعی از یک تکنولوژی نوظهور تحقیقاتی به ابزار تعیین کننده سیاست، اقتصاد و فرهنگ جهانی تبدیل شده است. در حالی که میلیون ها نفر از مدل های هوش مصنوعی برای تولید محتوا، آموزش، تجارت یا تحلیل داده استفاده می کنند، تعداد کمی از شرکت ها کنترل زیرساخت های حیاتی این فناوری را در دست دارند. شرکت هایی مانند گوگل، OpenAI، متا، آمازون و Anthropic نه تنها مالک مدل های بزرگ زبانی و پردازنده های قدرتمند هستند بلکه جریان توسعه، تحقیق و حتی قوانین نظارتی را نیز جهت می دهند. این تمرکز قدرت، موضوع بحث داغی بین متخصصان فناوری و فیلسوفان اجتماعی شده است زیرا تبعات آن می تواند آینده آزادی دیجیتال و عدالت اقتصادی را تغییر دهد.

از دیدگاه اجتماعی، تمرکز قدرت در چند دست خاص شباهت زیادی به انحصارات قرن بیستم دارد. همان طور که صنایع نفت و ارتباطات در گذشته توسط چند غول اقتصادی کنترل می شدند، امروز نیز منابع محاسباتی و داده های عظیم در اختیار شرکت هایی است که تعیین می کنند چه کسی به مدل های هوش مصنوعی دسترسی دارد و با چه هزینه ای. بسیاری از دانشمندان معتقدند که اگر روند فعلی ادامه یابد، نوآوری های مستقل عملاً از بین خواهند رفت چون زمینه فنی، سرمایه اولیه و داده های لازم در اختیار نهادهایی است که هدفشان حفظ انحصار است.

خلاصه مقاله و کاربرد

هدف این مقاله، توضیح و تحلیل جنبه های مختلف تمرکز قدرت در حوزه هوش مصنوعی است. ما بررسی می کنیم که چه عواملی باعث شکل گیری این تمرکز شده اند، پیامدهای مستقیم و غیرمستقیم آن چیست، و چگونه می توان با سیاست گذاری یا همکاری های باز از خطراتش کاست. همچنین به فناوری های متن باز، نقش دانشگاه ها و دولت ها در مقابله با این روند اشاره خواهیم کرد.

در نهایت، خواهید دید که تمرکز قدرت در هوش مصنوعی صرفاً یک مساله فنی نیست بلکه ریشه در ساختار سرمایه داری، رقابت شدید منابع محاسباتی و حتی تفکر فلسفی انسان درباره خلق هوش دارد.

فهرست مطالب

- مفهوم تمرکز قدرت در هوش مصنوعی

- دلایل فنی و اقتصادی تمرکز

- نقش شرکت های بزرگ و مدل های انحصاری

- خطرات اجتماعی و اخلاقی

- چالش های متن باز و مقاومت در برابر انحصار

- مقابله با تمرکز قدرت از دیدگاه سیاست گذاری

- آینده هوش مصنوعی؛ تمرکز یا توزیع؟

- نتیجه گیری

- سوالات متداول

مفهوم تمرکز قدرت در هوش مصنوعی

تمرکز قدرت در هوش مصنوعی به معنای انباشت کنترل منابع اصلی توسعه هوش مصنوعی در دست تعداد کمی بازیگر است. این منابع شامل داده های آموزشی، زیرساخت پردازشی، مدل های زبانی، سرمایه مالی و نفوذ سیاستی می شود. در واقع، حتی اگر هزاران محقق در سراسر جهان به مطالعه AI مشغول باشند، تصمیم واقعی درباره جهت گیری فناوری معمولاً توسط چند شرکت در آمریکا و چین گرفته می شود.

مقاله Fast.ai به درستی اشاره می کند که این تمرکز نه طبیعی است و نه اجتناب ناپذیر، بلکه حاصل سیاست گذاری های خاص و تصمیمات سرمایه گذاری بزرگ در دهه گذشته است. به عنوان مثال، زمانی که هزینه ساخت یک مدل زبانی چند میلیارد دلار می شود، شرکت های کوچک عملاً از رقابت حذف می شوند. از دید بعضی تحلیلگران این شبیه “تمرکز هوش” در ساختارهای قدرت است، جایی که توانایی فهم و خلق معنا تنها در دست صاحبان منابع دیجیتال باقی می ماند.

جالب است که تمرکز قدرت در هوش مصنوعی حتی در سطح داده هم وجود دارد. داده های آموزشی اغلب از شبکه های اجتماعی، مقالات و محتوای عمومی جمع می شوند، اما دسترسی به این داده ها برای آموزش مدل جدید معمولاً محدود و تجاری شده است. این خود باعث نابرابری شدیدی میان تیم های تحقیقاتی مستقل و شرکت های دارای انحصار داده می شود.

دلایل فنی و اقتصادی تمرکز

برای درک بهتر تمرکز هوش مصنوعی، باید به فاکتورهای فنی و اقتصادی نگاه کنیم. تولید مدل های بزرگ زبانی مانند GPT یا Gemini به حجم عظیمی از GPU و TPU، میلیاردها داده آموزشی و تیم های فنی سطح بالا نیاز دارد. به همین دلیل ورود به این بازار تنها برای شرکت هایی ممکن است که بودجه های کلان دارند.

از دید اقتصادی، رقابت در میان این شرکت ها بیشتر بر مبنای سرمایه و مالکیت سخت افزار است تا نوآوری خلاقانه. ساختار هزینه ها به گونه ایست که حتی دانشگاه ها و موسسات تحقیقاتی مستقل نمی توانند در مقیاس مشابه فعالیت کنند.

در جدول زیر می توان بخشی از تفاوت منابع بین شرکت های بزرگ و پروژه های مستقل را مشاهده کرد:

| نوع منبع | شرکت های بزرگ (مانند گوگل، OpenAI) | پروژه های مستقل یا دانشگاهی |

|---|---|---|

| زیرساخت محاسباتی | میلیون ها واحد GPU و TPU | حداکثر چند صد GPU |

| بودجه تحقیقاتی سالانه | بیش از 1 میلیارد دلار | کمتر از 10 میلیون دلار |

| داده آموزشی اختصاصی | حاصل از قراردادهای تجاری و شبکه های بزرگ | محدود به داده های عمومی |

| نیروی انسانی تخصصی | هزاران مهندس و متخصص هوش مصنوعی | تیم های کوچک 10 تا 30 نفره |

| نفوذ سیاستی و رسانه ای | بسیار بالا | تقریبا محدود |

این تفاوت فاحش یکی از دلایل اصلی تمرکز قدرت است. برخی معتقدند که آینده هوش مصنوعی زیریساختیمحور خواهد بود، نه داده محور، یعنی هرکه سخت افزار بیشتری داشته باشد، خودش را در راس هوش قرار می دهد.

نقش شرکت های بزرگ و مدل های انحصاری

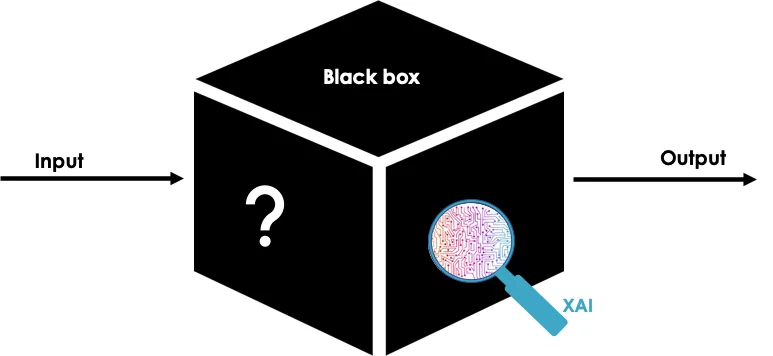

شرکت های بزرگ فناوری با استفاده از منابع وسیع خود توانسته اند مدل های زبانی و مولد را در سطح جهانی عرضه کنند. اما نکته اصلی اینجاست که اغلب این مدل ها به صورت بسته و غیر قابل مشاهده منتشر می شوند. کاربران می توانند از آن ها استفاده کنند اما نمی توانند کد یا داده های پشت آن را ببینند. این رویکرد، که توسط شرکت هایی مثل OpenAI و Anthropic دنبال می شود، باعث شد که هوش مصنوعی از یک ابزار علمی آزاد به محصول انحصاری تبدیل شود.

مدل های انحصاری نه تنها اطلاعات آموزشی را محافظت می کنند بلکه نتایج خروجی را نیز از دید تحلیل گران بیرونی پنهان می سازند. همین مساله باعث می شود که مطالعه شفافیت و بی طرفی مدل سخت یا حتی غیر ممکن شود.

برای نمونه، وقتی GPT یا Claude متنی تولید می کند، هیچ کاربر خارجی نمی داند دقیقاً بر چه داده هایی آموزش دیده یا چه الگوریتم تصحیحی در پشت صحنه کار می کند. این “جعبه سیاه بودن” به شرکت اجازه می دهد تا سیاست های خود را بدون نظارت عمومی اجرا کند. برخی کارشناسان، از جمله نویسندگان مقاله Fast.ai، معتقدند که این مدلها بیشتر به قدرت نرم سیاسی شباهت دارند تا ابزار صرفاً فناوری.

خطرات اجتماعی و اخلاقی

تمرکز قدرت در هوش مصنوعی تنها یک مساله اقتصادی نیست؛ پیامدهای اجتماعی و اخلاقی عمیقی دارد. وقتی کنترل الگوریتم هایی که بر تصمیم های مالی، آموزشی، رسانه ای و حتی قضایی تاثیر می گذارند در دست چند شرکت محدود باشد، خطر سوگیری جمعی و تحریف داده واقعیت وجود دارد.

یکی از مسائل مهم این است که مدل های هوش مصنوعی می توانند نحوه تفکر جوامع را جهت دهند. اگر شرکت سازنده تصمیم بگیرد که در خروجی مدل، برخی دیدگاه های سیاسی یا فرهنگی را کمتر نمایش دهد، عملاً آزادی بیان جهانی تحت تاثیر قرار می گیرد.

از نظر اخلاقی، تمرکز قدرت می تواند منجر به “مالکیت معنای انسانی” شود. چون مدل های زبانی در حال بازتولید زبان، احساس، خلاقیت و هنر هستند، وقتی انحصار در دست چند شرکت باشد، خلاقیت جمعی بشر در خدمت اهداف تجاری قرار می گیرد.

در سطح جهانی، این پدیده ممکن است شکاف دیجیتال بین کشورهای فقیر و ثروتمند را عمیق تر کند. کشورهایی که توانایی دسترسی به زیرساخت های هوش مصنوعی را ندارند، ناچار خواهند بود به مدل های خارجی وابسته شوند، و این یعنی از دست دادن استقلال اطلاعاتی و فرهنگی.

چالش های متن باز و مقاومت در برابر انحصار

در واکنش به روند تمرکز، موجی از پروژه های متن باز در سراسر دنیا شکل گرفته است. مدل هایی مثل LLaMA از متا، Mistral، Falcon، و Hugging Face Transformers نمونه هایی از تلاش برای دموکراتیزه کردن هوش مصنوعی هستند. این پروژه ها سعی دارند امکانات توسعه مدل های بزرگ را برای جامعه باز و پژوهشگران مستقل فراهم کنند.

اما مشکلات زیادی وجود دارد. حتی اگر مدل ها متن باز باشند، هزینه آموزش و اجرای آن ها چنان بالاست که عملاً دسترسی آزاد هنوز نیازمند حمایت مالی جدی است. شرکت های بزرگ نیز گاه از متن باز به عنوان نوعی بازاریابی استفاده می کنند ولی در نهایت کنترل داده و زیرساخت را در دست خود حفظ می کنند.

برخی محققان پیشنهاد داده اند که دولت ها باید زیرساخت های محاسباتی عمومی ایجاد کنند تا مناسب پژوهشگران و شرکت های کوچک باشد. این کار باعث می شود رقابت عادلانه تر شود و تمرکز بیش از حد در بازار از بین برود.

یکی از اشتباهات رایج در درک متن باز این است که مردم تصور میکنند باز بودن کد کافیست، در حالی که تا زمانی که سخت افزار و داده باز نباشد، تمرکز قدرت همچنان باقی خواهد ماند.

مقابله با تمرکز قدرت از دیدگاه سیاست گذاری

دولت ها و سازمان های بین المللی در حال بررسی قوانین جدید برای کنترل این تمرکز هستند. اتحادیه اروپا با قانون AI Act سعی دارد شفافیت، امنیت و پاسخگویی در مدل های هوش مصنوعی را الزامی کند. در آمریکا نیز بحث هایی درباره مالیات بر GPU و کنترل مالکیت داده مطرح شده است.

برخی پیشنهادها شامل موارد زیر است:

- الزام شرکت ها به انتشار بخشی از داده های آموزشی برای بررسی بی طرفی.

- ایجاد آزمایشگاه های عمومی هوش مصنوعی با دسترسی آزاد.

- نظارت بر قراردادهای تجاری تامین سخت افزار و انرژی برای مدل های بزرگ.

- جلوگیری از انحصار پلتفرم های هوش مصنوعی در کاربردهای حیاتی مانند آموزش و سلامت.

اجرای این سیاست ها البته چالش برانگیز است، چون شرکت های بزرگ نفوذ زیادی در دولت ها دارند. حتی گاهی دولت ها به جای محدود کردن تمرکز، به دنبال همکاری با این شرکت ها برای اهداف امنیتی یا نظامی هستند. این تناقض نشان می دهد که سیاست گذاری در این حوزه باید هم اخلاقی و هم واقع بینانه باشد.

آینده هوش مصنوعی؛ تمرکز یا توزیع؟

پرسش اساسی اینجاست که آیا آینده هوش مصنوعی اجتناباً متمرکز می شود یا می تواند به صورت توزیع یافته رشد کند؟ برخی معتقدند که با رشد مدل های کوچک اما کارآمد، ممکن است قدرت از شرکت های بزرگ به توسعه دهندگان مستقل منتقل شود. مدل های فشرده، آموزش تطبیقی و الگوریتم های کم هزینه می توانند مسیر جدیدی باز کنند.

در مقابل، گروهی بر این باورند که حتی با پیشرفت تکنولوژی، تمرکز ادامه پیدا خواهد کرد زیرا کنترل داده و سرمایه همچنان به چند دست محدود تعلق دارد. به ویژه شرکت هایی که توانایی ساخت تراشه و ذخیره انرژی عظیم دارند عملاً در موقعیت برتر باقی خواهند ماند.

اما شاید راه میانه وجود داشته باشد: همکاری های باز، مدل های ترکیبی و زیرساخت های اشتراکی جهانی. اگر جوامع علمی، دولت ها و بخش خصوصی بتوانند با هم کار کنند، آینده AI نه تحت سلطه بلکه در خدمت همه انسان ها خواهد بود. هرچند که این مسیر سخت و پرچالش است، ولی بی شک، آینده هوش مصنوعی به تصمیم امروز انسان ها بستگی دارد.

نتیجه گیری

تمرکز قدرت در هوش مصنوعی یکی از مهم ترین چالش های فناوری و جامعه در قرن بیست و یکم است. این تمرکز نه تنها تعیین می کند چه کسی از هوش مصنوعی سود می برد بلکه شکل عدالت اطلاعاتی و خلاقیت انسانی را نیز تغییر می دهد. اگر کشورها، دانشگاه ها و جوامع مدنی در برابر انحصارات دیجیتال اقدام نکنند، ممکن است آینده ای شکل گیرد که هوش در انحصار باشد و انسان صرفاً مصرف کننده الگوریتم شود. راه حل، سرمایه گذاری بر پروژه های متن باز، سیاست های شفاف سازی داده و همکاری جهانی است.

سوالات متداول

1. چرا تمرکز قدرت در هوش مصنوعی خطرناک است؟

زیرا کنترل اطلاعات، داده و تلاش های علمی را محدود به چند شرکت می کند که ممکن است از آن برای اهداف تجاری یا سیاسی استفاده کنند.

2. آیا پروژه های متن باز می توانند با شرکت های بزرگ رقابت کنند؟

تا حدی، بله. ولی نیازمند حمایت مالی و زیرساخت های عمومی هستند تا بتوانند قدرت واقعی را به دست آورند.

3. مهم ترین اقدام برای کاهش تمرکز چیست؟

شفافیت داده ها، مقررات ضد انحصار، و ایجاد مراکز تحقیقاتی مستقل یا مشترک بین دولت ها و دانشگاه ها از مهم ترین راهکارهای کاهش تمرکز است.